Tecnologismo digital como antesala de la inhumanidad

Ya no hay dioses como los de antes,

ni siquiera profetas

con sus anuncios del porvenir.

Ni ángeles del cielo o del infierno.

Un nuevo dios ha venido:

el algoritmo

(venerado como el oro del becerro).

Todo lo que tocamos

queda convertido en datos.

O. Jiménez, Fotografías versadas. Versos fotografiados

SUMARIO:

1. Introducción. 2. La tecnología digital como panóptico. 3. El algoritmo como nuevo Big Brother digital. 4. Big Brother digital, capitalismo de los datos y libertad ‘asistida’. 5. Conclusiones.

1 . Introducción

El deber de defender al hombre de la inhumanidad

Decía Gabriel Marcel que, en esta época, el deber primero del filósofo -quizá el único- es defender al hombre contra sí mismo. Defenderlo de la situación de inhumanidad en la que ya muchos han caído. Despertar (éveiller) las conciencias de los sueños monstruosos que producen todos los ‘ismos’ generados por el hombre (Marcel, 2001, 39). Y en esa línea se orientan las reflexiones que se exponen a continuación, ligadas al hiper-tecnologismo que hoy domina la sociedad.

No se trata de cuestionar los innegables logros que el desarrollo tecnológico ha proporcionado a la humanidad y que nos permiten vivir con un grado de bienestar inimaginable hace no muchas décadas. El peligro de inhumanidad no está en el uso instrumental de la tecnología, que ha sido y es inherente al progresivo mejoramiento de las condiciones de vida del ser humano (las flechas de sílex, la rueda, el bolígrafo o el automóvil son exponentes diversos de la tecnología). El peligro de inhumanidad, en el sentido de Marcel, se encuentra, a mi juicio, en el ‘tecnologismo’, es decir, en una concepción de la tecnología que ha dejado de ser instrumental y se ha convertido en parte sustancial de la idea de ser humano y de su relación con la realidad.

El tecnologismo

Es un hecho que esta posición crítica ante el tecnologismo apenas encuentra eco (ni siquiera entre el público ilustrado). Se da por sentado que la tecnología ‘es’ progreso, ‘es’ futuro y ‘es’ bienestar. No es infrecuente recibir el veredicto de reaccionario cuando se subraya que la tecnología ha sobrepasado las categorías instrumentales, las que permitían identificarla como un medio, y se está configurando como un componente esencial de la nueva antropología, hasta el punto de proponer un paradigma de futuro transhumanista, reflejado en el cyborg, un sujeto de naturaleza híbrida, producto de la fusión entre el hombre y la máquina, que operaría como un estadio transitorio hacia el definitivo posthumanismo, en el que se prevé una definitiva transición evolutiva desde lo biológico hacia lo digital.

No deja de sorprender que hoy aparezca como una hipótesis plausible, incluso como uno de los grandes desafíos de futuro para la ciencia, la posibilidad de traspasar toda la información del cerebro a un soporte digital (un chip) y establecer con ello una nueva manera de existir, una supuesta existencia inmortal al margen de las limitaciones de una corporalidad caduca (Ballesteros, 2020, p. 4).

La tecnología digital y el nuevo modelo de hombre y de conocimiento

En este contexto, el vector de influencia más decisivo y determinante del tecnologismo está representado por la tecnología digital, con ella se hace posible la transformación-recreación de lo real en virtual y, en última instancia, la transformación-reducción de la persona a datos. El exponencial desarrollo de esta singular tecnología está provocando un profundo cambio de modelo antropológico y también (y sobre todo) epistemológico. En efecto, nuestra natural relación cognitiva con la realidad, que siempre ha tenido un carácter hermenéutico y analógico, está siendo sustituida por una relación digital y matemática, por un análisis algorítmico de miles de millones de datos (Big data) que están constituyendo un nuevo modelo cognitivo que hoy impropiamente denominamos inteligencia artificial.

En la medida en que la tecnología digital va determinando cada vez más nuestro modo de ser y de conocer, vamos asumiendo acríticamente que el ideal humanista sobre el que se fundamentaba nuestro mundo analógico y antropocéntrico ha quedado obsoleto y vamos abriéndonos hacia un ideal posthumanista y postantropocéntrico, absolutamente configurando y diseñado por la tecnología (Braidotti, 2015, p. 37). En última instancia, la tecnología digital acaba por situarnos ante una gran paradoja: nos presenta a la máquina (velocidad e infalibilidad en el análisis de datos) como paradigma antropológico de futuro, mientras que desprecia a la persona, categorizándola como un algoritmo biológico imperfecto y caduco.

El modelo de inhumanidad que representa el tecnologismo, hacia el que hoy avanzamos con una extraordinaria celeridad de la mano de la tecnología digital, ha comenzado por minar los fundamentos sobre los que se asentaba hasta ahora nuestro modelo antropológico: la dignidad inalienable de todo ser humano y los derechos que la garantizan.

Objetivo de este estudio

En lo que sigue voy a enunciar brevemente los deletéreos efectos que la tecnología digital está proyectando sobre la persona y sobre los fundamentos constitutivos más radicales de lo que denominamos humanidad: destrucción de la intimidad (el ámbito más sagrado de la personalidad) facilitando un escenario de control y vigilancia sin precedentes, y destrucción de la libertad (presupuesto esencial de la dignidad y fundamento de los derechos básicos). Considero, pues, necesaria a una reflexión de fondo sobre este tema que no se está realizando y confío en que decidamos poner coto a la banalidad con la que se asume y promueve el paradigma digital.

2 . La tecnología digital como panóptico

Un nuevo modo de panoptismo

El medio digital ha configurado un modelo de relación social inédito en la historia: deshace las distancias, condensa los tiempos, aísla y conecta a la vez a los sujetos, hace que lo público y lo privado se mezclen, etc. La ciber-comunicación fomenta una personalidad híbrida en la que el sujeto desarrolla a la vez una existencia real y otra virtual; y en ésta última en particular, el sujeto se exhibe exponiendo su intimidad porque el imperativo de la vida digital es la exposición, la transparencia, el mostrarse para ser visto: se trata de un nuevo modo de panoptismo (Han, 2014a, p. 7).

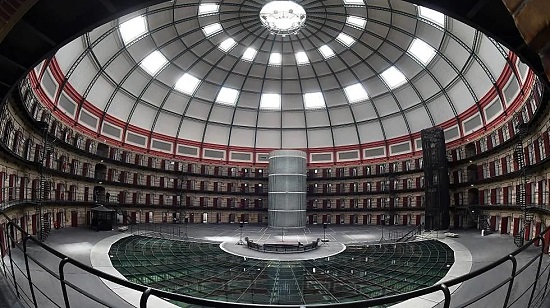

El ‘panóptico’ es, originalmente, un diseño arquitectónico de Jeremy Bentham (1748-1832), quien buscaba mejorar la convivencia social mediante un sistema de control que, por su eficacia, provocara la obediencia del ciudadano. Como imagen de su sistema propuso la idea de una torre de vigilancia para las cárceles, mediante la cual no era necesario realizar una vigilancia efectiva las 24 horas del día, ya que, debido a su altura, los presos nunca podían saber si el guardián los estaba controlando y eso les hacía generar la sensación de vigilancia permanente (Bentham, 2014). El ‘panóptico de Bentham’, se ha consagrado como paradigma de la sociedad disciplinaria (el Estado vigila siempre y a todos).

Posteriormente, ese modelo, plasmado en el conocido Big Brother de Orwell, fue sustituido por el panoptismo del ‘homo videns’ en la sociedad de masas, materializado en la televisión (el Estado controla lo que ves y todos ven lo mismo). En este segundo paradigma, los televidentes eran controlados en la medida en que todos recibían, pasivamente, el mismo contenido, y ese contenido era el que había decidido el poder (Sartori, 2002).

Supresión de la esfera privada de las personas

La digitalización de la sociedad global plantea una nueva modalidad de panoptismo, que da lugar a una nueva relación entre lo privado y lo público. El panóptico ‘televisivo’, en el que la posibilidad de exhibición estaba limitada y controlada por el interés del poder y de los medios, ha mutado hacia el panóptico ‘digital, una situación en la que cada sujeto quiere exhibir su intimidad en la red para tratar de conseguir una atención y reconocimiento que jamás le otorgaría un medio televisivo, público o privado. La obsesión por sentirse reconocido (que hoy se traduce en obtener el mayor número de likes) provoca la desaparición de la esfera privada de las personas.

Si calificamos lo privado como es esa zona de espacio y tiempo donde las personas no son una imagen (Barthes, 1989, p. 44), hoy ya no existe tiempo ni espacio sin cámaras y sin imágenes. Siempre hay dispositivos construyendo y proyectando una dimensión visual y pública de la persona. La red de comunicación digital es un entramado de interacción donde los individuos comparten su privacidad, sus datos, sus deseos y sus gustos en un espacio virtual, fundamentalmente compuesto por imágenes.

La obsoleta técnica analógica se ha transformado en la hegemónica tecnología digital: el homo economicus de la biopolítica moderna del XIX y el homo videns de la sociedad de consumo del siglo XX están dejando paso al homo digitalis de la sociedad cibernética. Y este nuevo modelo antropológico se cimenta sobre una nueva pauta de visibilidad y de control: el ‘panóptico digital’ en el que todos ven y todos son vistos (Mallamaci, 2018, p. 53).

El sujeto se convierte en consumidor y producto de consumo

El nuevo paradigma antropológico del homo digitalis se constituye sobre la exposición narcisista de sí mismo. En el modelo de sociedad digital, el sujeto ya no es un consumidor anónimo y pasivo de contenidos, sino que es un agente activo en la red, que se expone a sí mismo como producto y que consume lo que otros exponen de sí mismos. Todos los usuarios de la red son al mismo tiempo productores y consumidores de datos e imágenes. El homo digitalis actúa exponiendo su privacidad en la red y solicitando obsesivamente atención. Su interactividad digital, en realidad, no le lleva a relacionarse ni a vincularse con nadie, solo produce conexiones puntuales basadas en intereses fugaces, que se disuelven con la misma rapidez con la que el propio sujeto expone una nueva faceta de sí real o imaginaria (Han, 2014a, p. 17).

La transparencia como exposición inmediata y permanente

Por otra parte, el medio digital impone la presencia desde la inmediatez temporal. No puede haber tiempos de espera; los datos y las imágenes se envían y se reciben instantáneamente. Esto deriva en lo que Han ha denominado ‘transparencia’ (Han, 2014a, p. 24): un aquí y ahora permanente y compulsivo donde no existe el pasado ni el futuro. Esa inmediatez impide la reflexión y la profundidad del pensamiento y provoca que para el homo digitalis las imágenes virtuales tengan más relevancia que las presencias físicas de la vida real (Han, 2014a, p. 30-34).

En la sociedad digital para que algo consiga ser suficientemente real debe circular a través de las pantallas de los dispositivos digitales. Esto se traslada a la cotidianidad de los sujetos, que convierten su temporalidad en exposición permanente. Los individuos se integran voluntariamente en una vida digital en la que absolutamente todo está ‘a la vista’. No hay vida digital sin exhibición de la intimidad. El ‘panóptico digital’ significa la muerte voluntaria de la intimidad. La vida digital exige desnudarse, retirar todos los velos que hasta ahora cubrían movimientos, acciones, emociones y pensamientos de la persona, para exhibirlos en la red. La vida digital excluye por definición la intimidad. Para captar la atención de otros hay que mantenerse permanentemente conectado y eso exige un altísimo nivel de exhibición (Patino, 2020, p. 61).

La libertad se concibe como exhibición de la intimidad

Ahí radica la clave del ‘panóptico digital’: en que se plantea como un intercambio libre de intimidades en el que todos pueden y quieren participar. La libertad para el homo digitalis ya no radica en ser dueño de la intimidad sino justamente en lo contrario: en exponerla masivamente en los dispositivos. La idea digital de intimidad no consiste en proteger el ámbito más sagrado de la persona de la intromisión ilegítima de los demás, sino que consiste justamente en lo contrario, en poder exhibir libremente el núcleo más íntimo de su vida y poder contemplar el de cualquiera, sin restricciones.

En efecto, bajo el imperativo de la ‘transparencia’ y la ‘exhibición’, en la sociedad digital la simple pretensión de no mostrar la intimidad en los dispositivos no genera respeto sino sospecha. No exhibirse equivale a ocultar. No tener presencia digital indica marginalidad o perversión. En el panóptico digital resulta extravagante, cuando no cómico, invocar un derecho a la protección de datos. Hay quien ha descrito esta pretensión como “la mayor mascarada jurídica de las últimas décadas” (Bellver, 2021, p. 51).

3 . El algoritmo como nuevo Big Brother digital

El control se produce ahora sobre los datos

En el ‘panóptico digital’, prima un infinito flujo de imágenes a través de las pantallas -en las que todos ven a todos- pero sobre el que ya nadie puede decidir el contenido.

Ese flujo de imágenes que continuamente se incorporan y circulan por las redes resulta incontrolable, sin embargo, la vigilancia y el control se siguen efectuando, y de una manera mucho más eficaz y sofisticada que en el Big Brother analógico, precisamente porque ahora el control se ejerce sobre los datos. Son los algoritmos de las Big Tech quienes ejercen la vigilancia a través del análisis de los miles de millones de datos que se obtienen de la actividad digital de los usuarios, y quienes tienen, por tanto, la capacidad de inducir los comportamientos a través de los requisitos de acceso a las aplicaciones y de las sugerencias de consumo de productos, a partir de la clasificación de las personas y la predicción sobre sus preferencias (Mallamaci, 2018, p. 51).

Los algoritmos son el nuevo mecanismo de vigilancia

La nueva forma de visibilidad que representa el ‘panóptico digital’ se asienta sobre ese nuevo mecanismo de vigilancia y control: los algoritmos. Con la tecnología digital, el Gran Ojo analógico de Orwell se convierte en un Big Brother digital instalado y exponencialmente multiplicado en las redes sociales a través del Big Data. Ya no solo vigila el Estado, sino que Facebook y Google se han convertido en el ojo que todo lo ve y en el cerebro que todo lo sabe (Han, 2014a, p. 75).

La consumación de este modelo de vigilancia acaba por ser total con el llamado ‘internet de las cosas’, que conoce hasta los más irrelevantes movimientos, gustos y preferencias que cualquier persona tiene en la vida más cotidiana de su propio hogar. El internet de las cosas es el mecanismo que interconecta y sincroniza los objetos y artefactos cotidianos con las dinámicas de la red digital, construyendo un sistema que almacena y controla todas y cada una de las acciones y preferencias del sujeto en todos y cada uno de los momentos de su vida diaria. Los relojes inteligentes, los asistentes virtuales, los motores de búsqueda, etc., han configurado un auténtico panóptico digital y una sociedad hiper-controlada: las cosas ya no son inertes, sino que ejercen una función amable pero implacable de vigilancia y control (Mallamaci, 2018, p. 52).

Un Big Brother digital

El ‘Gran Ojo’ del Big Brother ideado por Orwell lo veía todo a través de la telepantalla, garantizando así la estabilidad social. Resultó casi profético que, en el año 1984, Steve Jobs, en la presentación del primer modelo de ordenador de Apple, se preguntara si Orwell había tenido razón con la visión distópica expresada en su novela. La respuesta que dio fue: “Apple introduce Macintosh: ya veran por qué 1984 no será como 1984” (Isaacson, 2011, p. 151). Y tenía toda la razón. Hoy podemos decir que 1984 no fue como lo predijo Orwell, sino que fue mucho más allá de lo que éste puedo imaginar: fue el nacimiento de un Big Brother digital que funciona en términos de Big Data, y que constituye un dispositivo de control psicopolítico más efectivo que cualquier otra forma de control habida en la historia (Han, 2014b, p. 92).

La puesta en marcha de la WWW, una red global informática e interactiva, fue recibida por el mundo como una instancia tecnológica democrática para una sociedad abierta y global, que por fin se liberaba de la tutela y el control disciplinario del poder establecido y facilitaba la transparencia, la libertad de información y comunicación y la posibilidad de acceso a la verdad sin cortapisas. La realidad ha sido bien distinta. El Big Data funciona como un gigantesco almacén de información, donde los datos se cruzan y procesan por medio de sofisticados algoritmos, cuya misión no consiste liberar sino en predecir e inducir comportamientos, generando un nivel de control social casi inimaginable (O’Neil, 2016, p. 69-71).

Gran ojo que no ve, pero analiza

El substrato más profundo y oscuro de la vida digital está constituido por los algoritmos, que son la fuente del inmenso poder de control del Big Brother digital. La circulación, procesamiento y análisis de los datos que realiza el Big Data es el material con el que trabaja este nuevo Gran Ojo.

Los algoritmos conforman una especie de ‘panóptico ciego’ pero transparente; es decir, un gran ojo que no mira, sino que analiza. Aunque en las redes todo parece ser un tejido cristalino de imágenes compartidas, el nuevo principio de transparencia, control y vigilancia ya no tiene su eje en la imagen, sino en los datos, en los metadatos y en los patrones cifrados que se construyen a partir de ellos (Mallamaci, 2018, p. 52). El homo digitalis ha perdido su identidad metafísica y ha quedado reducido a una entidad matemática: los datos. El ‘panóptico digital’ se expande a base de imágenes, pero vigila, predice y controla a través de los datos y de los patrones algorítmicos que los procesan (Beer, 2016; 2017).

El ‘Big Brother digital’ transmite sensación de seguridad

No obstante, la singularidad del Big Brother digital radica en que maximiza su control algorítmico de un modo amable y persuasivo. En efecto, así como en la novela de Orwell el Gran Ojo transmite una angustiosa sensación de opresión y falta de libertad, el ‘Big Brother digital’ no intranquiliza ni angustia, al contrario, nos transmite una sorprendente sensación de seguridad. Fuera de las pantallas el homo digitalis se siente vulnerable e inseguro, no se percibe conectado al mundo, experimenta la soledad y el aislamiento de un náufrago. El homo digitalis para ‘ser’ necesita ‘ver y ser visto’ en la pantalla.

Precisamente cuando no está conectado, o no tiene la posibilidad de estarlo, es cuando realmente se siente desamparado (Bellver, 2020, p. 47). El homo digitalis ya no concibe su vida ‘real’ fuera de los dispositivos digitales; esto es, sin ser custodiado y controlado por ellos. La existencia de las personas ya no puede ser totalmente real si no se desenvuelve bajo los parámetros de una vida digital.

Psicopolítica

El Estado vigilante de Orwell representaba el paradigma biopolítico de la sociedad disciplinaria; es decir, la tecnología era un instrumento al servicio del poder para el control total de la vida. El ‘panóptico digital’ plantea un paradigma diverso, que es el de la psicopolítica: la persona no genera resistencia a la vigilancia y al control porque se siente libre, nadie le obliga a exhibirse, al contrario, la libertad de comunicarse ilimitadamente con todos le induce a volcar voluntariamente su vida (sus datos) sobre los dispositivos digitales sin que le importe que se recopilen y se procesen, ni le importe quién ni para qué se haga. Incluso considera positivo que el procesamiento de sus datos le permita mejorar su capacidad de comunicarse y de encontrar lo que busca.

De esta manera, incluso los datos más íntimos se consiguen sin necesidad de forzar o engañar a la persona, porque es la propia persona quien gustosamente los ofrece al Big Brother digital que, lejos de aparecer o ser percibido como un instrumento de vigilancia y control, genera una increíble y sorprendente sensación de libertad (Han, 2014b, p. 33).

En la sociedad disciplinaria descrita por Bentham, la aspiración del sujeto oprimido era liberarse de la vigilancia; en la sociedad digitalizada, cada persona se expone voluntariamente para que todos la vigilen, mientras que el sistema acumula datos para nutrir a los algoritmos y condicionar los comportamientos sin que nadie aspire a liberarse sino todo lo contrario, todos quieren mostrarse en los dispositivos y afirman hacerlo libremente sin que admitan sufrir ningún género de compulsión u hostigamiento. La masa busca integrarse y participar en el panóptico digital ofreciendo libremente sus datos al Big Data y produciendo de este modo una especie de totalitarismo digital de los datos y de la información (Mallamaci, 2018, p. 55).

4 . Big Brother digital, capitalismo de los datos y libertad ‘asistida’

Instrumento del capitalismo

El Big Brother digital no solo ejerce un eficacísimo control y vigilancia algorítmica sobre las personas, sino que se ha convertido en el instrumento económico fundamental del capitalismo tardío, también llamado ‘capitalismo de la vigilancia’ encarnado de manera emblemática por las denominadas Big Tech (Zuboff, 2020, 61).

Estas corporaciones se han convertido, en tiempo récord, en los monopolios más grandes jamás vistos en la historia de la economía y han acumulado un poder tan gigantesco que es capaz de condicionar y determinar la vida de miles de millones de personas y las decisiones políticas y económicas de la práctica totalidad de los países desarrollados. Sus beneficios son astronómicos, pero las complejas artimañas de ingeniería fiscal les permiten apenas pagar impuestos. Su reputación es altísima, a pesar de la evidencia de que trafican con nuestros datos personales, que nos espían a través de los dispositivos, que precarizan el empleo de sus trabajadores y que sus opacos algoritmos influyen de manera decisiva en las decisiones que tomamos cada día (Bellver, 2020, p. 46).

La opinión pública recela de los bancos, las eléctricas, las petroleras, las farmacéuticas, etc., pero continúa fascinada con las empresas tecnológicas, aunque no pare de escuchar el discurso crítico de quienes denuncian que su poder es infinitamente mayor que el de cualesquiera otras. En la actualidad, cuando comprobamos que las instituciones políticas y sociales pierden aceleradamente su legitimidad ante la ciudadanía, por percibirse ineficaces y obsoletas, constatamos que ese espacio institucional lo han ocupado las Big Tech. La sonrisa de Amazon, la manzana de Apple, el cuadrado multicolor de Microsoft o las características tipografías de Google o Facebook son marcas convertidas en tótems, en cuya cercanía todos quieren morar (Zuboff, 2020, p. 139).

Consumo emocional

Por otra parte, como señala Bellver, al igual que la naturaleza o el genoma humano son ‘res communes omnium’ y, por ello, integran el patrimonio común de la humanidad, el Big Data debería entrar de lleno en esa categoría de bienes, cuya propiedad nadie se puede atribuir. Sin embargo, las Big Tech se han apropiado de esos datos, algo que es de todos, y, ante nuestra sorprendente pasividad, lo utilizan exclusivamente en su propio beneficio, sin que esto suscite alarma social, ni movilice la acción concertada de los gobiernos del mundo para evitarlo (Bellver, 2020, p. 47).

La razón por la cual las personas no vinculan a las grandes tecnológicas con las prácticas más oscuras y manipuladoras del capitalismo radica, como señala B.C. Han, en que el capitalismo tardío ha mutado desde una economía del consumo hacia una economía de la emoción que explota lo afectivo: sentimientos, emociones y afectos son los elementos que hoy definen a un capitalismo inmaterial. Han demuestra que el medio digital trabaja como un medio del afecto; es decir, que la comunicación digital transporta más afectos que la comunicación analógica.

Si el homo economicus funcionó primero sobre el ‘valor de uso’ y luego sobre el ‘valor de cambio’, ahora trabaja sobre el ‘valor emotivo’, porque hoy el mercado se rige fundamentalmente por un consumo emocional. Por eso, las nuevas estrategias de mercado consideran las emociones como recursos económicos. Así pues, el medio digital genera productividad y consumo a través de generar la sensación de libertad y de promover la exhibición emotiva de la personalidad (Han, 2014a, p. 9-12).

De Big Brother a Big Deal

En última instancia, el Big Brother digital -y su ariete algorítmico de control, el Big Data– terminan funcionando como un Big Deal (Han, 2014b, p. 98), esto es, como una red global de negocios donde los datos personales son capitalizados. Las personas no solo son recursos humanos, sino que son ‘paquetes de datos’ explotables económicamente. En la sociedad digital todo queda registrado: cada descarga, cada click, cada compra, cada me gusta, cada consulta, cada comentario, etc.

El ciberespacio funciona como una especie de mundo gigantesco, abstracto e infinito, formado por unos y ceros, que permite un almacenamiento ilimitado de datos y donde el ‘Gran Ojo’ ya no puede ser humano, sino digital, porque las enormes masas de datos solo pueden ser recopiladas, leídas e interpretadas por los algoritmos de la inteligencia artificial. La emergencia del entramado algorítmico se ha convertido en una estructura cotidiana de las relaciones económicas, sociales e institucionales, de manera que su intervención es absolutamente decisiva en la toma de decisiones porque la valoración de los datos escapa ya a los actores humanos.

La trama algorítmica es hoy el presupuesto necesario de cualquier tipo de acción institucional, comercial, gubernamental, etc. (Beer, 2017, p. 5). El poder de los algoritmos está desfigurando el concepto analógico (prudencial, cognitivo) de la libertad y está configurando un nuevo modelo de libertad digital, que tiene a excluir la posibilidad del error y ofrece el horizonte de la ‘única solución correcta’.

Una libertad tecnológicamente ‘asistida’

La inteligencia artificial se mueve así en una dinámica totalitaria, puesto que el poder clasificatorio y predictivo de la tecnología algorítmica escapa por completo de las limitadas capacidades cognitivas de los seres humanos. En consecuencia, el tratamiento algorítmico de los datos no solo está destruyendo la intimidad, sino que también está devaluando (cuando no desacreditando) a pasos agigantados el ejercicio analógico de la libertad humana regida por la capacidad de tomar decisiones autónomas desde la reflexión, la prudencia y la experiencia (Sunstein, 2001, p. 39).

En efecto, la ‘inteligencia artificial’, constituida por la acción de sofisticados algoritmos que procesan miles de millones de datos a la velocidad de la luz, plantea al sujeto la inconveniencia de tomar decisiones basadas únicamente en las capacidades cognitivas de la persona, siempre limitadas, habitualmente sesgadas y no pocas veces equivocadas. De este modo, no son pocos quienes advierten de nuestra deriva hacia una libertad tecnológicamente ‘asistida’ (Lassalle, 2019, p. 46-47). Puesto que nuestras capacidades cognitivas son limitadas y ante la evidencia de que los algoritmos manejan con absoluta eficiencia toda la información existente sobre cualquier cuestión, parecería temerario no asumir este recurso cuando se trata de tomar decisiones en asuntos de relevancia, si el algoritmo nos ofrece análisis precisos y propuestas de decisión que resultan absolutamente irrefutables (Bellver, 2020, p. 49).

Un ejemplo del ámbito judicial

En el terreno judicial, por poner un ejemplo de decisiones relevantes, ¿qué juez, apelando a su juicio prudencial, se atrevería a discrepar del resultado que le ofrece un programa informático como el ‘VioGen’, a la hora de tomar decisiones respecto al riesgo de maltrato de una mujer y las medidas de protección que debe implementar? Es más, ¿quién puede confiar ya en la decisión judicial de un sujeto humano falible y corruptible, frente a la decisión objetiva, incorruptible e infalible de un algoritmo? Las máquinas son infinitamente más fiables, ágiles, eficaces e imparciales que el más eficiente de los jueces humanos (Trazegines, 122-124).

5 . Conclusiones

Impunidad del tecnologismo

El avance de la tecnología digital aparece hoy no solo como irreversible sino, sobre todo, como deseable, hasta el punto de que resulta inconcebible que ese avance pueda dificultarse apelando a principios éticos o a razones precautorias. El único debate serio suscitado en el campo de la tecnología digital es el de cómo regular bien sus posibles usos abusivos para prevenir el ciberdelito. Todo el análisis al que hoy sometemos el desarrollo tecnológico empieza y acaba ahí: una buena regulación y un uso razonable (Cotino, 2017). Sin embargo, no parece preocuparnos la increíble impunidad con la que se abre paso la tecnocracia digital como componente indiscutible e imprescindible de la vida personal y social, de la actividad económica y de la toma de decisiones políticas.

Psicopolítica y esclavitud digital

El inmenso poder de vigilancia y control de la tecnología digital y de la inteligencia artificial nos ha introducido de lleno en lo que Han denomina la era de la ‘psicopolítica’ (Han, 2014b, p. 12). La masiva utilización de los dispositivos digitales hace que los sujetos se crean dueños de su libertad y liberados de las viejas cadenas de la esclavitud analógica. Sin embargo, lo que en realidad sucede es que las coacciones no son externas sino internas, las cadenas de la nueva esclavitud digital tienen que ver con la voluntaria exhibición de la intimidad y la consciente y voluntaria entrega de los datos personales.

Ahora la coacción es mucho más eficaz porque el homo digitalis se encuentra encadenado a las clasificaciones y predicciones de los algoritmos, que manipulan nuestra psique a través de lo emotivo y condicionan nuestros deseos a través del análisis de patrones de comportamiento. Creemos ser felices por tener la posibilidad de operar en un espacio virtual lleno de infinitas posibilidades, pero nos hemos convertido en esclavos de una vida digital que exige una conexión permanente y que se alimenta de devorar nuestra intimidad (Morozov, 2018, p. 78).

En la era de la psicopolítica y del poder inteligente, en realidad, nos mostramos más sumisos y obedientes que nunca a las exigencias que imponen los dispositivos digitales para poder acceder a sus aplicaciones y productos. El mal al que hoy se teme ya no está en la vigilancia o el control por parte del poder, sino en la exclusión del mundo digital. Existir significa tener presencia digital (Whitaker, 1999, p. 172).

Pérdida de la dignidad y de los derechos del ser humano

Nunca en la historia se produjo un nivel tal de distorsión entre la sensación falsa de plena libertad y la esclavitud real a la que el sujeto está sometido por el poder digital. Y esto significa que, en la medida en que nos vamos entregando más al hipertecnologismo digital, como presupuesto indiscutible de relación social, económica y política, vamos asumiendo una dimensión totalitaria del poder inteligente (psicopolítica) y una esclavitud voluntaria a cambio de mantener una ilimitada conexión a los dispositivos digitales.

El discurso de los derechos solo tiene sentido en una sociedad analógica; esto es, en una sociedad que se fundamenta sobre el presupuesto de la dignidad de la persona, en tanto que sujeto racional y libre. Pero se trata de una racionalidad que nada tiene que ver con la inteligencia artificial y de una libertad que nada tiene que ver con el procesamiento infalible de datos llevado a cabo por los algoritmos. El homo digitalis no se explica ni se fundamenta sobre la dignidad y los derechos, sino que se construye y se desarrolla sobre el acceso y la interacción en una realidad virtual. Sorprende que tantos lo contemplen como un ideal de futuro y de progreso.

Sigue vigente la advertencia de Camus

Albert Camus ya lo advirtió en su discurso de aceptación del premio nobel de literatura en 1957, teniendo en mente el peligro que entonces representaban los enormes arsenales atómicos de las dos grandes potencias del momento:

Indudablemente, cada generación se cree destinada a rehacer el mundo. La mía sabe, sin embargo, que no podrá hacerlo. Pero su tarea es quizá mayor. Consiste en impedir que el mundo se deshaga.

El peligro de un holocausto nuclear se desactivó entonces y el mundo asumió una tendencia desnuclearizadora. A mi modo de ver, la tecnología digital constituye hoy una nueva amenaza de deshumanización. Confío en que también consigamos desactivarla.

Otros artículos de P. Talavera publicados en esta web:

La pobreza y sus diversos enfoques (Diciembre 2018)

La deconstrucción de la medicina (Febrero 2020)

REFERENCIAS UTILIZADAS EN TECNOLOGISMO DIGITAL COMO ANTESALA DE LA HUMANIDAD

BENTHAM, J. (2014). El panóptico. España: Globus.

BELLVER, V. (2021). “Transhumanismo, discurso transgénero y digitalismo: ¿exigencias de justicia o efectos del espíritu de abstracción?”. Persona y Derecho, vol. 84, p. 17-53.

BALLESTEROS, A. (2020). “Tecnología digital: ¿realidad aumentada o deformada?”. Cuadernos Electrónicos de Filosofía del Derecho, n. 42.

BARTHES, R. (1989). La cámara lúcida. Nota sobre la fotografía. Barcelona: Paidós.

BEER, D. (2017). “The social power of algorithms”. Information, Communication & Society, vol. 20, n.1, p. 1-13.

BRAIDOTTI, R. (2015). Lo posthumano. Barcelona: Gedisa.

COTINO, L. (2017) “Big data e inteligencia artificial. Una aproximación a su tratamiento jurídico desde los derechos fundamentales”. Dilemata, n. 24, p. 131-152.

HAN, B. Ch. (2014a). En el enjambre. Barcelona: Herder.

HAN, B.Ch. (2014b). Psicopolítica. Neoliberalismo y nuevas técnicas de poder. Barcelona: Herder.

ISAACSON, W. (2011). Steve Jobs. Random House Mondadori.

LA SALLE, J.M. (2019). Ciberleviatán. Barcelona: Arpa.

MALLAMACI, M. (2018). “Los tres panópticos. Análisis de las modulaciones del poder y las formas visuales de control entre la Modernidad y el siglo XXI”. Digithum, n.º 22, p. 47-58.

MARCEL, G. (2001). Los hombres contra lo humano. Madrid: Caparrós.

MOROZOV, E. (2018). Capitalismo Big Tech: ¿Welfare o neofeudalismo digital? Madrid: Enclave.

O’NEIL, C. (2016). Weapons of Math Destruction: How Big Data Increases Inequality and Threatens Democracy: London: Crown.

PATINO, B. (2020). La civilización de la memoria de pez. Madrid: Alianza.

SUNSTEIN, C.R. (2001): República.com. Internet, democracia y libertad. Madrid: Paidós.

SARTORI, G. (2002). Homo videns. La sociedad teledirigida. Madrid: Taurus.

TRAZEGNIES F. (2013). “¿Seguirán existiendo jueces en el futuro?: el razonamiento judicial y la inteligencia artificial”. Ius et Veritas. n. 47, p. 112-131.

WHITAKER, R. (1999). El fin de la privacidad. Barcelona: Paidós.

ZUBOFF, S. (2020). La era del capitalismo de la vigilancia. Barcelona: Paidós.

About the author

Pedro Talavera. Facultad de Derecho. Universidad de Valencia

Buenas tardes profesor. Me gustaría mucho citar algunas ideas de su artículo ¿Me podría indicar cómo debo referenciar el artículo?

Buenos días, Danyela. Gracias por ponerte en contacto con nosotros. Puede citarlo como un página web siguiendo las normas APA 7 para un artículo con autor:

Talavera, P.(7 de abril de 2022). Tecnologismo digital como antesala de humanidad. Red de Investigaciones filosóficas José Sanmartín Esplugues

https://proyectoscio.ucv.es/articulos-filosoficos/articulos_fondo/tecnologismo-digital-como-antesala-de-la-inhumanidad/